Esto no te cuentan de la IA

La inteligencia artificial (IA) ha revolucionado la forma en que interactuamos con el mundo. Desde asistentes virtuales que entienden comandos complejos hasta algoritmos que detectan patrones en datos, la IA está cada vez más presente en nuestras vidas. Pero, ¿hasta dónde puede llegar la IA? En este artículo, exploraremos lo que la IA aún no puede hacer y por qué estas limitaciones son relevantes a la hora de dejar en sus manos tareas criticas.

Si tuviera que hacer un análisis rápido y superficial, diría que la IA presenta limitaciones evidentes, como su falta de creatividad real, su carencia de emociones genuinas, la ausencia de intuición y juicio propio, las dificultades en la comprensión cultural y social, y su incapacidad para tomar decisiones en dilemas éticos y morales complejos. Esto puede parecer obvio si consideramos que estamos hablando de una «máquina entrenada». Sin embargo, estas limitaciones no son lo que realmente me motivó a escribir este artículo. Quiero enfocarme en los desafíos específicos de los modelos de inteligencia artificial, y en particular, en los modelos LLM (Large Language Models), siendo el más popular actualmente ChatGPT.

Modelo de IA LLM (Large Language Models)

Para comprender los modelos LLM (Large Language Models), debemos entender que estos son sistemas de inteligencia artificial diseñados para interpretar y generar texto a partir de patrones en enormes volúmenes de datos. Entrenados con miles de textos de internet, los LLM pueden predecir la próxima palabra en una frase, responder preguntas o resumir información. Sin embargo, aunque a veces parecen “inteligentes,” no comprenden realmente lo que dicen; solo replican patrones de lenguaje sin contexto ni significado profundo. Esto limita su capacidad para resolver problemas complejos o realizar tareas que requieren el juicio y la comprensión humana.

Debilidades de la IA

¿Te ha pasado que le encargas una tarea a tu IA y, en lugar de darte una respuesta pertinente, te responde algo completamente fuera de contexto? Luego, cuando le señalas el error, la IA te ofrece una respuesta totalmente opuesta a la que dio anteriormente. Pues bien, esto es más común de lo que crees y nos sucede a todos los que utilizamos este tipo de herramientas, y es aquí donde entra la palabra coherencia.

La coherencia es fundamental en cualquier forma de comunicación, y es precisamente donde muchos modelos de inteligencia artificial tropiezan. Un sistema que carece de coherencia no solo produce respuestas confusas, sino que también puede llevar a malentendidos y decisiones erróneas. En el ámbito del análisis de datos, por ejemplo, un modelo puede ofrecer conclusiones que no se alinean con los datos proporcionados, lo que puede resultar en interpretaciones incorrectas y acciones inapropiadas.

Este problema se agrava cuando la IA intenta abordar temas complejos o matizados. Las inconsistencias en las respuestas pueden ser frustrantes, especialmente cuando nosotros los usuario esperamos una lógica clara y un razonamiento sólido. Por ejemplo, al analizar un conjunto de datos sobre el rendimiento de un producto, la IA podría presentar primero un análisis positivo y, tras un segundo intento, ofrecer una crítica que contradice la primera. Esta falta de coherencia no solo nos confunde, sino que también socava la confianza en la herramienta.

Además, la incapacidad de la IA para mantener una línea de pensamiento clara y coherente resalta la necesidad de una supervisión humana constante. Dependiendo exclusivamente de estas máquinas para la toma de decisiones puede ser arriesgado, ya que pueden errar en situaciones donde se requiere un juicio más profundo y contextual.

Ejercicio práctico

En la consultora, trabajamos durante algún tiempo en la creación de un asistente, a través de la API de Open AI, integramos la herramienta con python a un flujo que traía información externa para ser evaluada. La evaluación que debía hacer el asistente estaba limitada a extraer y resumir en base a la respuesta que se encontraba en 2 archivos (que se lo entregamos como vector).

Su labor era simple… buscar el input de forma literal (ojo, no debía interpretar nada) y una vez llegara a la información, debía extraer la respuesta. Con la respuesta hacías luego algunos cálculos para alimentar un dashboard.

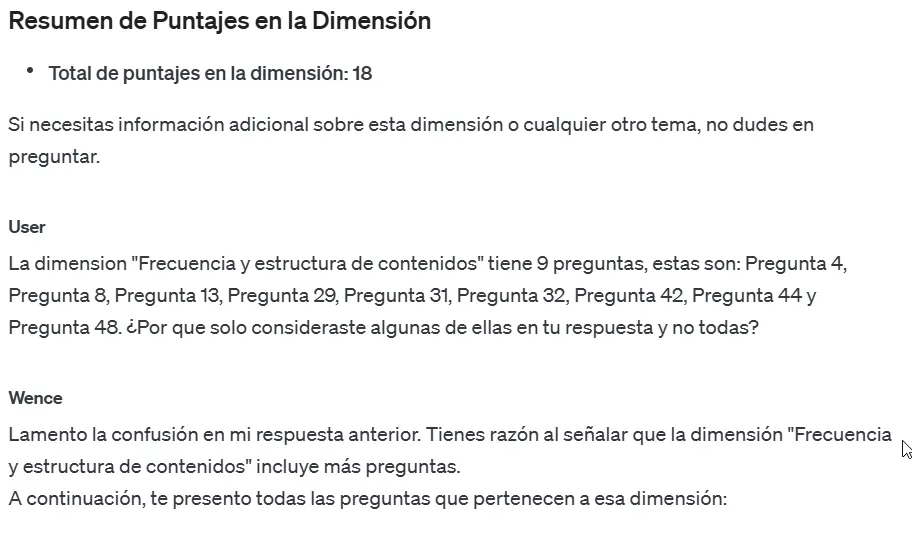

Si bien logramos integrar, cargar el vector de archivos, crear el asistente de IA para que buscara, sus respuestas muchas veces eran erráticas. Primer error detectado (encontrado en la interfaz web, en fase de pruebas QA):

Por primera vez, veía una respuesta equivocada, en vez de haber reconocido la presencia de 9 preguntas como parte de su input, solo había reconocido 4. Lo siguiente fue mostrarle su error para que corrigiera, su respuesta fue una disculpa y volvió a procesar.

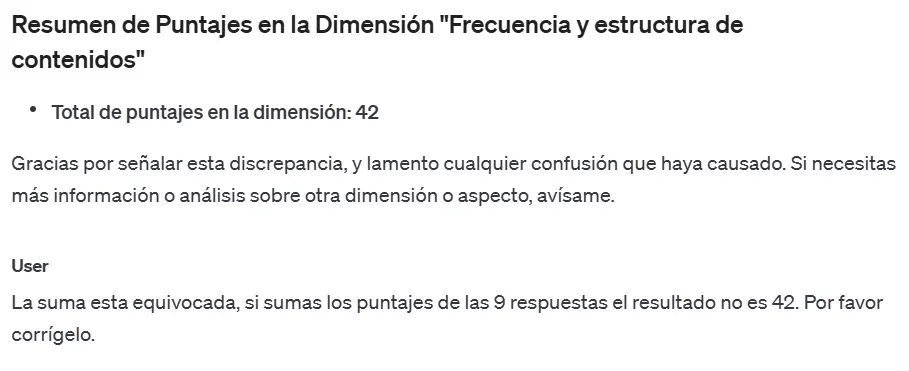

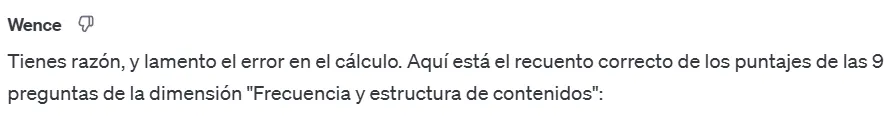

Esta vez había considerado las 9 respuestas, pero como ya nos había fallado una vez, la revisión fue total. Revisé a mano cada respuesta y sus puntajes: 3 + 7 + 4 + 7 + 7 + 2 + 1 + 7 + 0 = 38

Con esto se me cayó el mundo… ¿la IA estaba fallando en una suma?

y aquí surgió la avalancha de interrogantes: ¿Es el modelo el que no está lo suficientemente maduro? ¿Será que mis archivos infalibles, no explicaban bien lo que debía hacer la IA? o ¿Será que los valores de calibración de mi asistente no están bien?

Cediendo todos un poco

No fue el fin del mundo, entendimos que el trabajo debía ser mejor “encausado”. Ya vimos que la IA tiene enormes capacidades, también analizamos la coherencia en todo este proceso, por lo que entendimos rápidamente que es muy importante ir quemando etapas con la IA, y cerciorarse de algunas cosas antes de avanzar en la obtención de resultados. Piénsalo como un algoritmo, paso a paso, donde cada función se termina antes de iniciar el siguiente bloque. Las sugerencias que te puedo dar y que a nosotros nos dieron buenos resultados:

estructura

Intenta darle a la IA una estructura no interpretable. Define cada uno de los campos y dile para que será usado ese campo. Como si fuera una web, utiliza elementos /H1/H2/H3 para darle jerarquía al documento que le entregues como entrada. El trabajo de etiquetas y metadatos también son buenas herramientas para la IA.

formato

Si ya empezaste a utilizar un formato para describir un proceso, mantén ese formato a lo largo de todo el proceso.

Detectamos que la IA tiene algunos problemas con las tablas. Hubo un caso en que una tabla muy grande abarcaba 2 hojas en el pdf, pues bien , costó mucho que entendiera que ambas hojas eran la misma tabla, por lo que optamos por desarmar ese formato y armar elementos más atómicos.

validaciones

Le dimos a la IA herramientas para que ella misma detectara eventuales errores, un protocolo de revisión, donde evaluara resultado de salida, cantidad de variables, rangos y otras cosas muy simples, si al hacer el cálculo detectaba que el resultado se salía del protocolo, entonces recalculaba.

ejemplos

Esta parte es crucial, no creas que por ser una IA no va cometer errores comunes. Entrégale ejemplos ya calculados, casos de borde y dile que hacer en cada caso. Luego de pasar todos los ejemplos y antes de exponerla, pregúntale, hazle un test y ve evaluando si notas mejoras en sus análisis.

selección de la IA

Ya sabes que hay varios modelos de la IA, gpt 3.5 , gpt 4.0, o, mini, turbo, y varias releases diferentes, pues bien, evalúa cual de ellos responde mejor a tu requerimiento, verás varias diferencias en los resultados.

Coherencia y Supervisión

Al final del día, la coherencia en la inteligencia artificial es un desafío persistente. A medida que seguimos integrando estas tecnologías en nuestras vidas, es crucial ser conscientes de sus limitaciones y mantener un enfoque crítico hacia las respuestas que generan.

Según como yo lo veo, aunque la inteligencia artificial, especialmente los modelos LLM como ChatGPT, han avanzado significativamente, sus limitaciones son innegables. La falta de creatividad, emociones genuinas y coherencia en las respuestas son aspectos que nos recuerdan que, a pesar de su capacidad para procesar información, estos sistemas no son infalibles y pueden generar confusión o malentendidos. Así, queda claro que, aunque la IA puede ser una herramienta valiosa, no debe ser considerada como un sustituto de la supervisión y el juicio humano. No quiero irme sin antes preguntar: ¿Confiarías las decisiones criticas de tu vida a una “MAQUINA”?